搜索网站、位置和人员

走进西湖

院系设置

betway必威棋牌网址

招生与奖励

新闻与活动

校园生活

betway下载地址

人才招聘

师生入口

电话: +86-(0)571-86886861 公共事务部

以下,是很多人熟悉的日常:

开车出门,打开手机上的地图APP,用导航规划最优线路。

进入商场、医院或学校,绿码是你的“通行证”,这是过去一年来逐渐适应的新常态。

到了晚上,微信运动则会用一条推送消息提醒你,今天一共走了多少步。

看上去,人类与科技的共生无比和谐。然而,当真如此吗?当技术带来便利,我们当真没有面对未来的焦虑吗?当文明发生更迭,我们当真没有面对过去的不舍吗?

2021年首场“遇见WeMeet”人文社科系列活动上,洪小文博士就从“数据、计算、人工智能与人类未来”的主题出发,与西湖师生分享了他的见解。

“又期待,又怕受伤害。”他这样描述人们身处AI时代的内心情感。如何看待这种矛盾而纠结的情绪?洪小文没有给出答案,但他在分享中提到的三本刊物,或许能够为这些情绪的纾解提供一些视角。

洪小文

微软全球资深副总裁

微软亚太研发集团主席

微软亚洲研究院院长

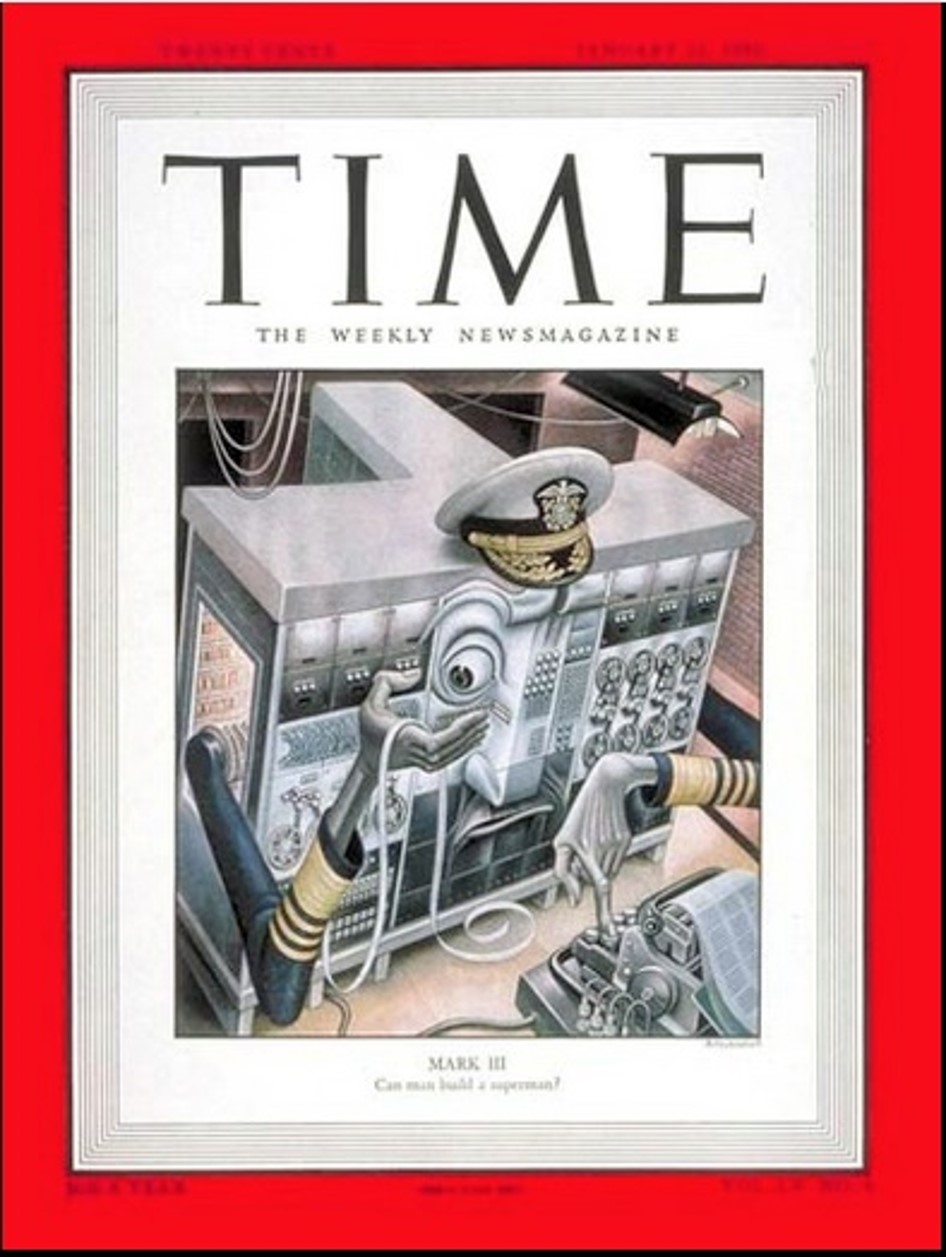

读《TIME》(1950)

对智能的恐慌,远早于AI本身

AI有多重要,已经不需要我再多说什么,如今包括中国在内的世界上几乎每一个国家,都在谈论和布局AI,也就是人工智能。但在高涨的热情背后,我们也无法忽视另一种声音——对智能技术的恐慌。

怎么看待这种情绪?

我们先从语义的角度看。“人工智能”的反义词是“天然愚蠢”,没有人想要天然愚蠢,所以大家更喜欢AI。人类之所以成为世界的主导力量,也正是因为我们比其他动物聪明得多,我们不比老虎壮,也不比大象大,但拥有智能的人类,能够学会对周围的事物实现控制。

以自动驾驶为例,如今我们讨论自动驾驶,毫无疑问认为它是一种AI技术。可是你知道吗?据维基百科,飞机的自动驾驶系统在100多年前就已经实现了,那时候连电脑都还没有,更别提AI这个说法。

所以,到底什么是智能?当我们一次又一次提出对人工智能的担忧和恐慌时,我们到底在怕什么?那些书中提到的可怖的、甚至有可能接管人类的“超级智能”,有多大可能会成真?

让我们换一个历史的视角来看这个问题。

这是一本发行于1950年的《时代》杂志,封面故事讲的就是对“超级智能”的担忧。注意,这是一篇70年前的媒体报道,当时全世界只有多少台计算机?我不知道确切的数字,但我想可能不到十个,而且价格很高、体积很大,即便在美国,也只有与军事相关的项目才用得起电脑。当时“人工智能”甚至连影子都还没有,这个词直到六年后的达特茅斯研讨会(Dartmouth workshop)上才被创造出来。

显然,即便没有AI,但那时的人们已经开始担心了——我们将要造出一些比我们自己还要聪明的东西?!

读《意识光谱》

创造力无法“学会”,只能被激发

如果1950太远,我们来讲讲大家更熟悉的Alpha Go。

我认为,“算法”是解决问题的过程,最有用的创造力就是提出算法的能力。而今天的计算机,还不具备这样的创造力。

也许你曾经这样想过:和Alpha Go下棋是一件多么不公平的事啊!这背后得有多少计算机的算力?电脑太聪明了!

但你有没有换一个方式思考这个问题:为什么要在模式识别和死记硬背上与电脑竞争呢?Alpha Go诞生的意义,本质不也是计算机解决问题的过程吗?这就好像一个很擅长开根号的人,哪怕可以开到小数点后100位,电脑也可以做到,但不必比试吧?

有一本书叫《意识光谱》,作者肯恩·威尔伯是美国最著名的心理学家。他把人的意识分成高光谱和低光谱,你可以这样理解,高光谱是指你早上醒来的时候,喝一杯咖啡,然后开始做一些需要计算和记忆的工作,效率高且不会出错;低光谱则是指结束一天的工作和学习后,你觉得有点晕,你觉得你需要打个盹,做个白日梦,或者索性大睡一觉。

有意思的是,历史上有很多故事告诉我们,多数时候人们最有创造力的时刻反而是在低光谱中。贝多芬失去了听力,却创作出很好的交响乐;梵高割破了的耳朵,但仍然绘就美丽的画幅;还有证实了神经传递的信号是化学信号的诺贝尔奖获得者Otto Loewi,据说是在梦里梦到了实验过程,而且一连梦了两次。

我想说的是什么呢?在座有很多学生和教授,你们比我更清楚,创造力没法“教”,也没法“学”,它只能被激发。

我可以负责任地说,目前还没有任何证据表明计算机可以自己编写程序。也就是说,如果计算机要自己写算法,它就得具备写算法的能力,而这种能力本身又是一种新的算法。好比人有左脑和右脑,我们仍然需要富有创造力的右脑来想出算法,这是一种协同。

读《工具,还是武器》

科技如何真正向善

总体来说,技术还是好的,人们其实真正担心的是数字鸿沟、公民安全、隐私泄漏、虚假新闻、数据偏见,甚至军事战争……

所以常常有人说,我们需要对包括AI在内的科技进行规范和监管,但其实真正应该规范的还是人类本身不是吗?毕竟,任何东西都有其缔造者。就像一把刀,好人用它做饭,坏人用它杀人,但我们并不会去责怪刀,而是责怪使用这把刀的人。

同样的道理,任何的监管都是面向人,而不是面向技术。技术的确非常强大,人们担心的是会不会有人将之用于歧途。我想,一家公司如微软,或一所大学如西湖,都应该正视并重视自己所承担的道德和责任的议题。比如那些生命科学的实验,比如基因编辑、克隆等,其实也有很敏感的东西。

所以,担忧也不是坏事,这促使很多人、很多国家开始采取措施,政府、社会及科技企业正在合作制定政策、法规、法律。但我今天更想启发大家去关注的是,当我们拥有这些强大的技术时,我们更需要做的是去回馈社会,所谓AI for good、科技向善,我们如何真正让人工智能变得更好,如何使用智能技术为需要的人提供帮助?

世界是平的,但并非人人生而平等……

环境也很重要,极端气候、水资源短缺、碳排放……

在很多国家和地区,贫富差距还在不断被拉大……

类似的问题还有很多很多,而这些是我们真正要去思考的。

在数千年的人类文明长河里,也许每一次理论与技术的更迭都曾在当下带来过恐惧,人们怀疑、抵触、甚至反抗。但文明,不就是在这样一轮轮的更迭中往前走的吗?1950年引起人们恐慌的技术,不也逐渐变成我们今天习以为常并拥抱赞美的生活方式了吗?

正如洪小文博士在分享最后所说,面对一个智能的时代,面对不断更迭的文明,也许最好的应对方式,是试图获得终生学习的动力和能力。

最新资讯

大学新闻

我在西湖读博士